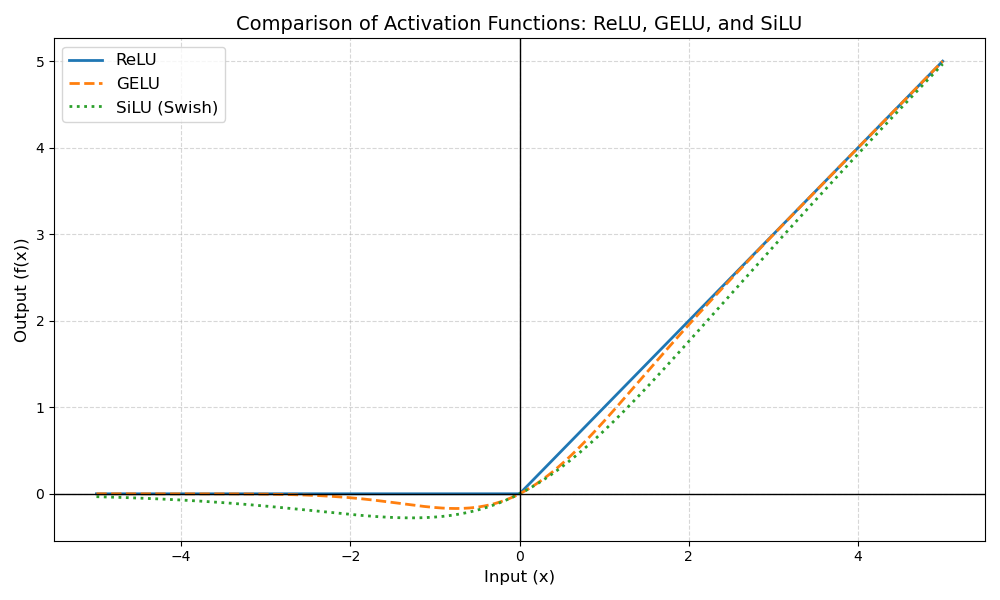

以下是一些常见的激活函数:

ReLU

一个里程碑,解决了 Sigmoid 和 tanh 的梯度消失问题,计算极其简单:

- 注意到 时导数恒为 1,意味着梯度可以无损地传递到下一层

Leaky ReLU

为解决 ReLU 的死神经元问题,在负半轴引入了一个小量 ,避免梯度完全消失:

GELU

结合输入 和标准正态的 CDF:

随着 的增大, 趋近于 1,输出趋近于 ;随着 的减小, 趋近于 0,输出趋近于 0。

常用 tanh 近似:

其中 为标准正态的概率密度函数。

- 允许负值通过,且具有更复杂的非线性部分,全局连续可导。

SiLU

与 ReLU 相似, 增大时趋近于 1, 减小时趋近于 0。

SwiGLU

在 Llama 中的 MLP 层被采用,是一种带门控机制的结构: